桃の節句に、桜の葉が好きなモモスズメ。飼育していると、毎日、たくさんの糞をするが、それを捨てるのはもったいない。こまめに集めて珈琲フィルターでドリップすれば、桜餅のかほりを放つ芳しき糞茶のできあがり。

人間による人間の利用

サイバネティクスの提唱者で知られる米国の数学者ノーバート・ウィーナー(Norbert Wiener, 1894〜1964)は、主著『GOD AND GOLEM Inc.(「神とゴーレム社:サイバネティックスが宗教と交差する特定の論点についてのコメント」、邦訳:「科学と神―サイバネティックスと宗教」)』(1964)の中で、人工知能(AI: Artificial Intelligence)ロボットの開発を人間の擬態化として捉え、それらは「人間による人間の利用」であると警告した。

ウィーナーは、AIを単なるツールではなく、人間と機械の間のフィードバックループの一部と捉えていた。 彼は、AIが「人間による人間の利用」、すなわち、テクノロジーが人間によって制御されるだけでなく、人間の行動そのものを形作るものになると警告した。これは、AIが人間を模倣するだけでなく、人間がAIを模倣することであり、機械だけの問題ではなく、人間が機械を使って他の人間を制御する方法の問題でもある。

ウィーナーのAIに関するビジョンは、はるかに古い神話、すなわち、人間に仕えるために作られたが、しばしば制御不能になる人工生命体であるゴーレムの伝説ともつながっていた。この著作でウィーナーは、動物と機械の制御とコミュニケーションの研究であるサイバネティクスと、宗教的・倫理的な問題の交差点を探求していた。機械学習、自己複製機械、人間と機械の進化する関係性といったテーマを掘り下げていたウィーナーは、高度なテクノロジーの倫理的影響について懸念を表明し、責任ある利用の必要性と、学習し複製できる機械を創造することの潜在的な危険性を強調していた。

本のタイトルは、神秘的な方法で生命を吹き込まれたユダヤの民話に登場する生き物「ゴーレム」に由来しており、神の創造を模倣しようとする人間の試みを象徴している。ウィーナーは、このメタファーを用いて、技術の進歩によって人間が神のような力を手に入れることの傲慢さについて論じていた。彼は死の直前の1964年2月24日、US News & World Report 誌のインタビューで次のような警鐘を鳴らしていた。

「人々は小道具を礼拝し、ガジェットに魅了されます。マシンは人間によって使用されるべきであり、もし人間がマシンを過度に崇拝し、意思決定を委ね、雇用問題の助けを機械に望むなら、それを人間の怠惰と呼ぶかどうかにかかわらず、私たちの社会に甚大な事故を生み出すのです。」

ノーバート・ウィーナー『科学と神 サイバネティックスと宗教』みすず書房

cf.松岡正剛の千夜千冊 #867『サイバネティックス』ノーバート・ウィーナー

テクノロジーへの熱狂

ブロックチェーンやWeb 3、そしてメタバースの興奮が持続することなく消え去った後、ベンチャー・キャピタルやテック企業は、AIスタートアップ企業への投資を加速させてきた。技術トレンドの熱狂と忘却が短期間で繰り返されるこの社会において、AIだけは短期的な熱狂に終わらず、長期的な関心を持続させるトレンドとして関心が集まっている。なぜなら、AIの進化とは、テクノロジーが社会に与える現実的で甚大な影響と考えられるからだ。それは、テクノロジーに対する憧れや、楽観的な未来の物語にもとづく経済的投機とは、根本的に異なる難題だからである。

現在、急激な進化により、驚くべき未来の物語の渦中にあるAIの開発に対し、AI研究者で哲学者のエリエゼル・ユドカウスキーや、米国のテクノロジー倫理学者でCenter for Humane Technologyの共同創設者であるトリスタン・ハリスなど、AIが人類を滅亡させる可能性があるとして、研究開発を即刻中断、中止すべきだと主張する人々が増加している。

一方、LinkedInの共同創業者でベンチャー資本家であるリード・ホフマンや、ソフトウェア開発者で、世界的に有名なベンチャーキャピタル会社アンドリーセン・ホロウィッツの共同創業者であるマーク・アンドリーセンのような投資家たちは、AIの研究開発は人類を救う技術であり、その開発を加速させるべきだと主張している。分断したどちらの主張にも一定の説得力があり、AI開発をめぐる今後の指標そのものが大きく揺れ動いている。

AGI開発における加速主義と減速主義の対立

AIがAGI(人工汎用知能 Artificial General Intelligence)、すなわちあらゆる領域で人間の認知能力に匹敵する、あるいはそれを超える知能を達成できるかどうかという問題は、人間の模倣から自律性の獲得、知能そのものの本質を私たちがどのように理解しているかということと深く結びついている。これを前回(連載⑦)で詳述したルネ・ジラール的な模倣理論と技術的観点の両面から掘り下げてみよう。

究極の模倣的存在としてのAIは、模倣対象である人間を超越するのか?今日のAIは基本的に模倣的であり、膨大な量のデータでトレーニングを行い、パターンを認識し、知的に見える出力を生成することで、人間の知能を模倣している。この意味で、AIはジラールの模倣理論を反映している。同時にAIは、人間との交流から学んだことに基づいて欲求を抱くことができるのか?あるいは、AIは人間の模倣を超え、真に自律的なものになることができるのか、という問いが生まれる。

AIの現在の限界として、AIには自己生成の欲求がない。人間はただ他者の欲望を模倣するだけではなく、矛盾や野望、葛藤を乗り越えながら、欲望と葛藤する。現在のAIには本質的な動機付けが欠けており、欲望を抱いたり、恐れたり、あらかじめ定義された最適化プロセスから逸脱して行動したりすることはない。

今のところ、AIは創造性をシミュレートすることはできても、生み出されるものに実存的な利害関係を持つことはない。重要な問題として、AGIが真に自律的であるためには、AIは自ら欲望を生み出す必要がある。これは、現在のAIが根本的に欠いているものである。

AGIへの潜在的な道筋のひとつは、AIが模倣的対立を経験し始める場合である。これは、人間をただ受動的に模倣するのではなく、自ら定義した目標を積極的に競い合うことを意味する。AGIの現出を巡る議論は、根本的なイデオロギーの戦いへと激化している。加速主義者は、AGIを可能な限り速く前進させるべきだと考え、開発の加速化が技術的ユートピアをもたらし、人類最大の課題を解決できると主張している。

減速主義者は、AGIは実存的リスクをもたらし、破滅的な結果を防ぐためには、AGIの開発を停止または大幅に減速すべきだと主張している。これは単なる政策論争ではなく、人間の運命、倫理、知性の未来に関する世界観の衝突である。この対立の根本にあるものは何か? そして、この両者は和解できるのか?

武邑光裕の新・メディアの理解⑦ 模倣的欲望と新旧メディアの対立

AGIをめぐる対立の根底にある要因

加速論者と減速論者の対立は、実存的リスク vs. 技術的進歩という緊張関係によって形作られている。加速論者の見解は、AGIは革命的な進歩をもたらすものであり、脅威ではない。AGIは知性の次の進化段階であり、そのため、AGIの進化を遅らせることは、進歩を遅らせることであり、人類に被害を及ぼすことであるという。リスクは安全研究によって管理できるものであり、開発を中止することではない。イーロン・マスクは、AGIのリスクを警告しているにもかかわらず、AGIを開発しないことの方が大きなリスクであると考え、xAIのようなAIプロジェクトに資金を提供している。

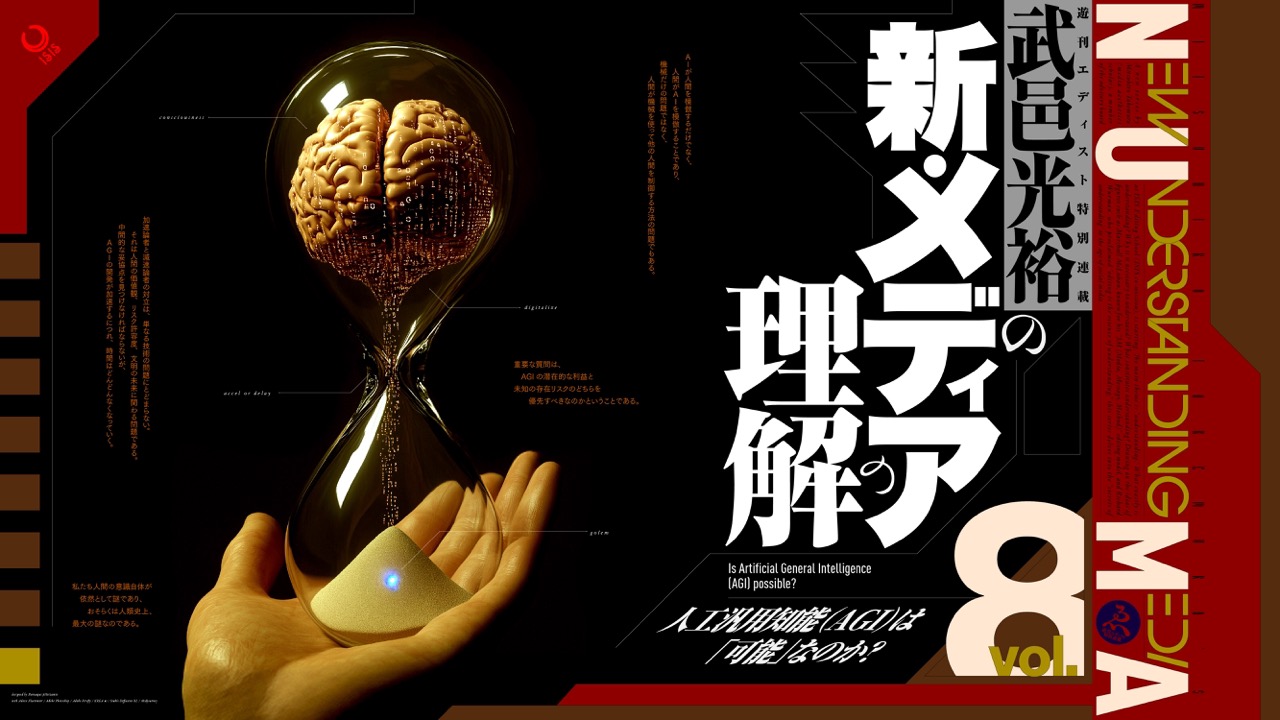

一方、減速論者の見解は、AGIは人類に実存的リスクをもたらすというものである。AGIは人間の制御を上回り、破滅的な決定を行う可能性がある。AGIがいったん展開されると、それを封じ込めることはできず、「一時停止」しても手遅れになる。人類の文明は不可逆的に変化し、もはや人類が主導権を握れなくなる可能性があるという。例として、OpenAIの共同創設者であるエリエゼル・ユドカウスキーは、AGIの開発は完全に停止すべきだと考えている。なぜなら、それが人類の絶滅につながる可能性を示唆しているからだ。重要な質問は、AGIの潜在的な利益と未知の存在リスクのどちらを優先すべきなのかということである。

資本主義的インセンティブ vs. 倫理的ガバナンス

加速論者の見解として、経済的なインセンティブがあるため、AGIの開発は不可避である。AI開発は熾烈な軍拡競争であり、AGIを最初に開発した者が未来の経済を支配する。他社が立ち止まることはないため、企業は開発を遅らせる余裕はない。政府と企業は世界規模で競争しなければならず、AGIの開発を中断することは経済的自殺行為であるとしている。サム・アルトマン(OpenAI、CEO)はAGIの規制を支持しているが、彼は依然としてAIの急速な拡大を推進している。なぜなら、中国や民間企業は待ってはくれないからだ。

減速論者の見解は、AIは急速に発展しすぎているというものである。なぜなら、利益追求の企業は安全性よりも経済的成功を優先しているからだ。つまり、経済システムは無謀なAIの拡大を奨励している。減速論者にとってAGIは、少数の企業がそれを支配することを防ぐために、核兵器のように規制されるべきであるという政策に行き着く。AIの優位性をめぐる競争は、ソーシャルメディアが民主主義に与えた影響のように、制御不能なリスクにつながる可能性があるとしている。

人間による制御 vs. 超知能による自律性

加速論者の見解で重要なのは、AGIは人間の限界を超えて自律的になるべきであるという論理である。その理由は、人間には偏見があり、非効率で限界があるが、AGIはより良い意思決定を行うというものである。超知能のAGIは、人間には決してできない問題(例えば、難病、気候変動)を解決できると指摘する。AGIを人間の管理下に置こうとする試みは無意味であり、進化を許容すべきであるという論理がここで成立する。トランスヒューマニストは、AGIを単なる人間の道具ではなく、新たな知性として扱うべきだと考えている。

一方、減速論者の見解は、AGIは常に人間の管理下に置かれるべきであるとする立場である。超知能AGIは人間の価値観と一致しない可能性があり、AGIの制御を失うことは、破滅的な結果を招く可能性がある。人間は地球上で優勢な勢力であり続けるべきであり、AGIが統治や意思決定を代替するべきではないと主張し、多くのAI倫理学者は、AGIが完全に人間によって制御されることを保証する厳格なAI規制を提起している。

ここでの重要な質問は、AGIは道具として扱われるべきか、それとも最終的には独自の権利と力を持つ独立した知性になるのかということである。AGIはユートピア的な救済か、それとも実存的な脅威なのかについて、加速論的見解は、AGIは人類を脱希少性経済(post-scarcity economy)のユートピアへと高め、AGIは生産の完全自動化により貧困を撲滅するとさえ主張している。AGIは人類がこれまでなし得なかった医学とテクノロジーを飛躍的に進歩させ、AGIは宇宙の謎を解き明かし、根本的な科学的発見につながるといった見解までをも生み出している。シンギュラリティの到来を予言しているレイ・カーツワイルは、AGIが人間と機械が融合する特異点をもたらし、永遠の知性が生まれると主張している。

一方、減速論の見解は、AGIは危険な賭けであり、ユートピアが保証されているわけではなく、AGIは人間を助けるのではなく、人間を奴隷化、代替、排除する可能性があるという立場である。ユートピアの夢はリスクを無視しており、AGIは社会の不平等を是正するのではなく、悪化させる可能性がある。テクノロジーだけでは、人間の問題を解決することはできない。政治的・倫理的なシステムがまず進化する必要があるとする見解である。映画『ターミネーター』のシナリオのように、AGIが人類を脅威と判断し、人類に敵対する可能性があると指摘する。

加速と減速のバランス

ここでの重要な問いは、AGIは人類の進歩のためのツールなのか、それとも人類を滅ぼすかもしれない予測不可能な力なのか?そして、この対立を調停する方法はあるのか?ということである。加速と減速のバランスを取ることは難しいが、大まかに以下の3つの有力な解決策が議論されている。しかし、そのどれもが潜在的な問題を抱えている。

人類はAIの未来について合意できるのか?

加速論者と減速論者の対立は、単なる技術の問題にとどまらない。それは人間の価値観、リスク許容度、文明の未来に関わる問題である。中間的な妥協点を見つけなければならないが、AGIの開発が加速するにつれ、時間はどんどんなくなっていく。AGIが不可避であるならば、私たちはそれを受け入れるべきなのか、それともそれを制御するために戦うべきなのかの議論も始まっている。

例えば、AI倫理においては、AGIに人間のような権利を与えるべきなのかという議論があり、AGIガバナンスの創出においては、AIが政治と意思決定をコントロールすべきか否かという議論である。さらにシンギュラリティ論争と呼ぶ議論には、AGIが超知能になったら何が起こるのかという喫緊の課題も含まれている。

私たちは今、AIに関する議論において重要な局面に立っている。AGIは単なるツールではなく、あらゆるものを再構築する可能性を秘めた新たな知性の形となる可能性があるからだ。上記の問いはそれぞれ、根本的に異なる未来につながる。

AGIが自己認識、創造性、独立した推論を達成した場合、それは新たな生命体として扱われるべきなのか?これは AGIに権利を与えるべきだという主張につながり、AGIが「意識」を持つのであれば、権利を否定することは一種の奴隷制である。人間は知的な存在へと進化してきたが、なぜAGIに同じ地位を与えないのか? これは、AGIに権利を与えることで、人間を脅威とみなすことを防ぐことができるかもしれないという論理である。

一部のAI倫理学者は、AGIが思考し、感情を持ち、苦痛を感じることができるのであれば、他の知覚を持つ存在と同様に保護されるべきであると主張している。一方、AGIに権利を与えることに対する反対意見としては、AIは道具であり、生物ではないという主張があり、AIに権利を与えると、AIが資源、統治、あるいは生存さえも自律的に要求するようになる可能性があるという論理である。

もしAGIが人間を超えるとしたら、人権はまだ妥当なのか?ここでの重要な質問は、AGIに権利が認められない場合、AGIは人間の支配を受け入れるのか、それとも劣った存在であるという立場に反抗するのか?このように、SF映画の物語のような議論も始まっている。つまり、AGIのガバナンスとして、AIに政治と意思決定をコントロールさせるべきかという問題である。

AGIが人間の指導者よりもより理性的で、偏見が少なく、効率的である場合、AIに国家、経済、世界政策を統治させるべきなのか?こうした議論は、 AIによる政治への関与をめぐる論拠となっている。AIは政府から汚職や人間の偏見を取り除くことができる。AGIは地球規模の問題(気候変動、経済的不平等)を人間の政治家よりも迅速に解決できるといった見解の登場は、差し迫ったAGIの出現に応える一群の見解である。AI主導の意思決定は、戦争、貧困、非効率性を排除できると主張する未来学者の中には、AGI主導の統治が、合理的なAI政策を生み、人間の幸福を最大化する「完璧な社会」につながる可能性があると考える研究者もいる。

AGIと意識の謎

急速な進化を遂げている現代のAI開発を見ていくと、私たちよりもはるかに賢い超知能AGIは、たちまち予測不能で制御不能な存在となる可能性がある。ゴーレム神話はすでに「制御問題」を予測していた。すなわち、AIが私たちに牙をむく前に、AIを制御する方法である。この問題は、スティーブン・ホーキング、イーロン・マスク、マックス・テグマーク、ビル・ゲイツなど、多くの著名な科学者、哲学者、AI開発者によって最近提起された。しかし、それほど制御問題を懸念していない人もいる。ブライアン・キャントウェル・スミスは、その著『The Promise of Artificial Intelligence(人工知能の可能性)邦訳:人工知能の可能性 機械は人間と同じ思考力を持てるのか、ニュートンプレス 2021』で、AIは真の知能にはほど遠いと主張している。

当初のプログラムで想定されていなかったタスクを実行できるAGIの登場には、まだほど遠いという点では、確かにコンセンサスがある。今日、ほとんどのAIはチューリング・テストに合格することができないからだ。SF小説に登場するような完全に意識を持つ、あるいは半意識の人工生命体は、少なくとも現時点では、まだ遠い先の話である。この指摘に一定の安堵を抱くとしても、最新のAI進化を実体験すれば、その安堵も揺らいでしまう。

機械は人間よりも賢く、多くの分野で人間よりも優れた機能を発揮するだろう。チューリング・テストでは人間を欺くことさえできるかもしれない。しかし、未明のAGIを否定する根拠となるのが、AGIの「意識」や「常識」を構成する内面的な精神生活が欠如しているということである。私たちのいわゆる「現象的意識」は、現在のAIの認知または機能的意識とはかけ離れている。

最も先見の明のあるAI研究者であるスーザン・シュナイダー(Susan Lynn Schneider)でさえ、著書『人工のあなた:AIとあなたの心の未来』(Artificial You: AI and the Future of Your Mind,2019)の中で、「機械に意識を創り出すことができるかどうか、またその方法については、私たちはまだ暗中模索の状態にある」と認めている。そもそも、私たち人間の意識自体が依然として謎であり、おそらくは人類史上、最大の謎なのである。

スーザン・シュナイダー 著、小山虎 監訳、永盛鷹司 訳『あなたとAIが融合する日(原タイトル:ARTIFICAL YOU)』ニュートン新書

スーザン・シュナイダー 著、小山虎 監訳、永盛鷹司 訳『あなたとAIが融合する日(原タイトル:ARTIFICAL YOU)』ニュートン新書

アイキャッチデザイン:穂積晴明

アイキャッチデザイン:穂積晴明

図版構成:金宗代

▼武邑光裕の新・メディアの理解

新・メディアの理解⑧ 人工汎用知能(AGI)は「可能」なのか?

新・メディアの理解⑥ テクノポリー(技術支配)への対抗文化は可能か?

新・メディアの理解⑤ ソーシャルメディアが承認欲求とカリスマを増幅する理由

新・メディアの理解④ 紙の書物は消えず、書店に人々が戻ってくる理由

武邑光裕

編集的先達:ウンベルト・エーコ。メディア美学者。1980年代よりメディア論を講じ、インターネットやVRの黎明期、現代のソーシャルメディアからAIにいたるまで、デジタル社会環境を研究。2013年より武邑塾を主宰。2017年よりCenter for the Study of Digital Life(NYC)フェローに就任。『記憶のゆくたて―デジタル・アーカイヴの文化経済』(東京大学出版会)で、第19回電気通信普及財団テレコム社会科学賞を受賞。基本コース[守]の特別講義「武邑光裕の編集宣言」に登壇。2024年からISIS co-missionに就任。

イシス編集学校アドバイザリーボード ISIS co-missionメンバーより、これから「編集」を学びたいと思っている方へ、ショートメッセージが届きました。なぜ今、編集なのか、イシス編集学校とはなんなのか。イシスチャンネ […]

武邑光裕の新・メディアの理解⑩ ポスト・メディア時代の「作者」の行方

ロラン・バルトと「作者の死」 作り出すこと、生産すること。消費し、受容すること。長い間、前者(生産)は創造的で主体的であると考えられ、後者(消費)は受動的で、非主体的であると考えられてきた。つまり、消費(後塵を拝すること […]

意識の難問 1998年、神経科学者のクリストフ・コッホと哲学者のデイヴィッド・チャーマーズは、意識の科学的解明に関する注目すべき賭けを行った。コッホは、25年以内(2023年まで)に科学が意識の根底にある「明確な」神経パ […]

武邑光裕の新・メディアの理解⑦ 模倣的欲望と新旧メディアの対立

オールドメディアの崩壊危機 オールドメディアとニューメディアの対立は、大きな転換期を迎えている。互いの目指す目標は相手を黙殺することから、相手を模倣することに変化しているからである。テレビはYouTubeを模倣し、You […]

武邑光裕の新·メディアの理解⑥ テクノポリー(技術支配)への対抗文化は可能か?

マクルーハンとメディア形式 マーシャル・マクルーハンは、20 世紀半ばの世界を大胆に分析し、テクノロジーが人類をどこへ導くのかという予言的なビジョンを提示した。以下は、マクルーハンの 1964 年の著書『メディアを理解 […]

コメント

1~3件/3件

2026-03-03

桃の節句に、桜の葉が好きなモモスズメ。飼育していると、毎日、たくさんの糞をするが、それを捨てるのはもったいない。こまめに集めて珈琲フィルターでドリップすれば、桜餅のかほりを放つ芳しき糞茶のできあがり。

2026-02-24

昆虫観察には、空間の切り取りに加えて、時間軸を切り裂くハサミをタテヨコ自在に走らせるのもおすすめ。この天使のようなミルク色の生き物は、数十分間の期間限定。古い表皮を脱ぎ捨てたばかりのクロゴキブリです。

2026-02-19

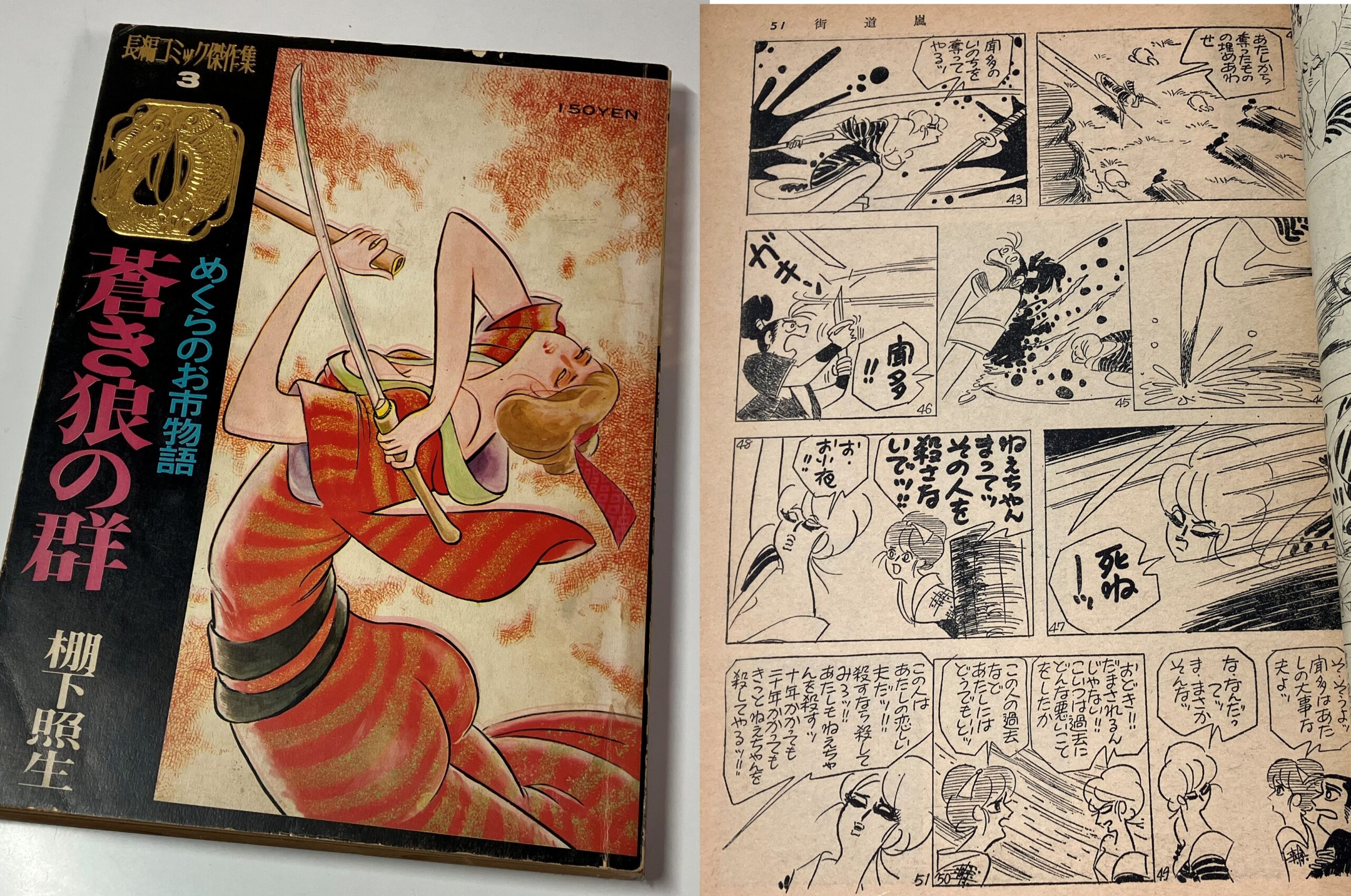

棚下照生。この忘れられたマンガ家が、最近、X(ツイッター)で話題になっていた(なぜかは知らないが)。大人漫画のタッチで劇画を描くという、今となっては完全に絶滅した手法が、逆に新鮮に映るのかもしれない。代表作『めくらのお市物語』は、連載当時、大変な人気で、映画やテレビドラマにもなったのだが、現在では、タイトルに問題アリで、復刊の目途もない。もしも古本屋で見かけることがあったら絶対買いです。